Всем привет!

Меня зовут Александр, я COO в SaaS-платформе аналитики данных. Последний год активно изучаю внедрение AI-решений в кросс-функциональные процессы. Делюсь материалами, которые помогают:

Продуктовым менеджерам — интегрировать AI без перегрузки команд;

Разработчикам — выбирать инструменты под конкретные бизнес-задачи;

Специалистам по данным — избегать ошибок в production-развертывании.

У себя в телеграм-канале делюсь сжатыми и структурированными саммери статей.

Сегодняшний перевод — Ahead of AI Understanding Reasoning LLMs

В этой статье описаны четыре основных подхода к созданию моделей рассуждений, или как мы можем улучшить LLM возможностями рассуждения. Надеюсь, это предоставит ценную информацию и поможет вам ориентироваться в быстро развивающейся литературе и шуме вокруг этой темы.

В 2024 году область LLM увидела растущую специализацию. Помимо предварительного обучения и тонкой настройки, мы стали свидетелями появления специализированных приложений, от RAG до помощников по коду. Я ожидаю, что эта тенденция ускорится в 2025 году, с ещё большим акцентом на оптимизацию по доменам и приложениям (т.е. «специализацию»).

Разработка моделей рассуждений является одной из таких специализаций. Это означает, что мы совершенствуем LLM для решения сложных задач, которые лучше всего решаются с помощью промежуточных шагов, таких как головоломки, продвинутая математика и задачи программирования. Однако эта специализация не заменяет другие применения LLM. Потому что преобразование LLM в модель рассуждения также вносит определенные недостатки, о которых я расскажу позже.

Чтобы дать вам краткий обзор того, что описано ниже, в этой статье я:

Объясню значение термина «модель рассуждений»

Рассмотрю преимущества и недостатки моделей рассуждений

Опишу методологию, лежащую в основе DeepSeek R1

Опишу четыре основных подхода к созданию и улучшению моделей рассуждений

Поделюсь мыслями о ландшафте LLM после выпуска DeepSeek V3 и R1

Предоставлю советы по разработке моделей рассуждений с ограниченным бюджетом

Надеюсь, вы найдете эту статью полезной, поскольку ИИ продолжает свое быстрое развитие в этом году!

Как мы определяем «модель рассуждений»?

Если вы работаете в сфере ИИ (или машинного обучения в целом), вы, вероятно, знакомы с расплывчатыми и горячо обсуждаемыми определениями. Термин «модели рассуждений» не исключение. В итоге кто-то формально определит его в статье, только для того, чтобы он был переопределен в следующей, и так далее.

В этой статье я определяю «рассуждение» как процесс ответа на вопросы, требующие сложной, многоступенчатой генерации с промежуточными шагами. Например, фактический вопрос вроде «Какая столица Франции?» не требует рассуждений. Напротив, вопрос типа «Если поезд движется со скоростью 60 миль в час и едет в течение 3 часов, какое расстояние он проедет?» требует некоторого простого рассуждения. Например, он требует понимания взаимосвязи между расстоянием, скоростью и временем, прежде чем прийти к ответу.

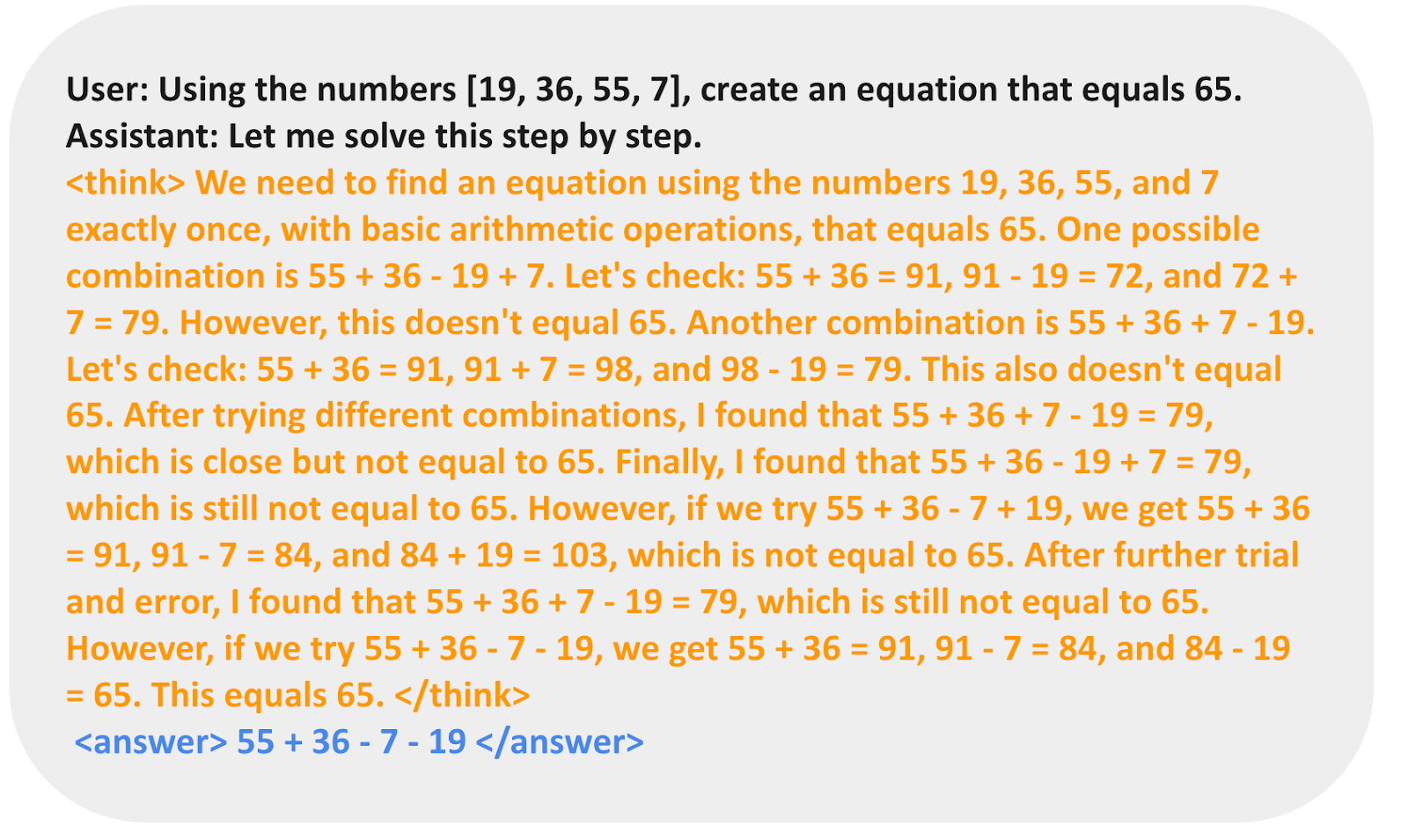

Обычная LLM может предоставить только короткий ответ (как показано слева), тогда как модели рассуждений обычно включают промежуточные шаги, которые раскрывают часть процесса мышления».

(Обратите внимание, что многие LLM, которые не были специально разработаны для задач рассуждения, также могут предоставлять промежуточные шаги рассуждения в своих ответах.)

Большинство современных LLM способны на базовое рассуждение и могут отвечать на вопросы вроде «Если поезд движется со скоростью 60 миль в час и едет в течение 3 часов, какое расстояние он проедет?» Поэтому сегодня, когда мы говорим о моделях рассуждений, мы обычно имеем в виду LLM, которые преуспевают в более сложных задачах рассуждения, таких как решение головоломок, загадок и математических доказательств.

Кроме того, большинство LLM, которые сегодня позиционируются как модели рассуждений, включают процесс «мысли» или «мышления» как часть своего ответа. Отдельной темой для обсуждения является вопрос о том, действительно ли и как LLM «мыслит».

Промежуточные шаги в моделях рассуждений могут проявляться двумя способами. Во-первых, они могут быть явно включены в ответ, как показано на предыдущем рисунке. Во-вторых, некоторые модели рассуждений, такие как o1 от OpenAI, выполняют несколько итераций с промежуточными шагами, которые не показываются пользователю.

Когда мы должны использовать модели рассуждений?

Теперь, когда мы определили модели рассуждений, мы можем перейти к более интересной части: как создавать и улучшать LLM для задач рассуждения. Однако, прежде чем погрузиться в технические детали, важно рассмотреть, когда модели рассуждений действительно необходимы.

Когда нам нужна модель рассуждений? Модели рассуждений разработаны для того, чтобы хорошо справляться со сложными задачами, такими как решение головоломок, продвинутых математических задач и сложных задач программирования. Однако они не нужны для более простых задач, таких как суммирование, перевод или ответы на вопросы, основанные на знаниях. Фактически, использование моделей рассуждений для всего может быть неэффективным и дорогостоящим. Например, модели рассуждений обычно дороже в использовании, более многословны и иногда более склонны к ошибкам из-за «чрезмерного обдумывания». Здесь также применяется простое правило: используйте правильный инструмент (или тип LLM) для задачи.

Ключевые сильные стороны и ограничения моделей рассуждений обобщены на рисунке ниже.

Ключевые сильные и слабые стороны моделей рассуждений.

Краткий обзор конвейера обучения DeepSeek

Перед тем как в следующем разделе обсудить четыре основных подхода к созданию и улучшению моделей рассуждений, я хочу кратко описать конвейер DeepSeek R1, как это описано в техническом отчете DeepSeek R1. Этот отчет служит как интересным примером, так и чертежом для разработки LLM с возможностями рассуждения.

Обратите внимание, что DeepSeek выпустил не одну модель R1, а три разных варианта: DeepSeek-R1-Zero, DeepSeek-R1 и DeepSeek-R1-Distill.

На основе описаний в техническом отчете я обобщил процесс разработки этих моделей на диаграмме ниже.

Далее давайте кратко рассмотрим процесс, показанный на диаграмме выше. Более подробная информация будет рассмотрена в следующем разделе, где мы обсудим четыре основных подхода к созданию и улучшению моделей рассуждений.

(1) DeepSeek-R1-Zero: Эта модель основана на предварительно обученной базовой модели DeepSeek-V3 671B, выпущенной в декабре 2024 года. Исследовательская команда обучила ее с использованием обучения с подкреплением (RL) с двумя типами вознаграждений. Этот подход называется обучением с «холодного старта», поскольку он не включал шаг supervised fine-tuning (SFT), который обычно является частью обучения с подкреплением на основе человеческой обратной связи (RLHF).

(2) DeepSeek-R1: Это флагманская модель рассуждений DeepSeek, построенная на основе DeepSeek-R1-Zero. Команда дополнительно усовершенствовала ее с помощью дополнительных этапов SFT и дальнейшего обучения RL, улучшив модель R1-Zero с «холодного старта».

(3) DeepSeek-R1-Distill*: Используя данные SFT, сгенерированные на предыдущих шагах, команда DeepSeek провела тонкую настройку моделей Qwen и Llama для улучшения их способностей к рассуждению. Хотя это не является дистилляцией в традиционном смысле, этот процесс включал обучение меньших моделей (Llama 8B и 70B, и Qwen 1.5B–30B) на выходных данных более крупной модели DeepSeek-R1 671B.

4 основных способа создания и улучшения моделей рассуждений

В этом разделе я опишу ключевые методы, которые в настоящее время используются для повышения возможностей рассуждения LLM и для создания специализированных моделей рассуждений, таких как DeepSeek-R1, OpenAI’s o1 и o3, и другие.

Примечание: точные принципы работы o1 и o3 остаются неизвестными за пределами OpenAI. Однако, согласно слухам, они используют комбинацию методов как для инференса, так и для обучения.

1) Масштабирование во время инференса

Один из способов улучшения возможностей рассуждения LLM (или любых возможностей в целом) — это масштабирование во время инференса. Этот термин может иметь несколько значений, но в данном контексте он относится к увеличению вычислительных ресурсов во время инференса для улучшения качества выходных данных.

Грубая аналогия заключается в том, как люди склонны генерировать лучшие ответы, когда им дается больше времени на обдумывание сложных проблем. Аналогично, мы можем применять техники, которые поощряют LLM больше «думать» при генерации ответа. (Хотя, действительно ли LLM «думают» — это отдельная дискуссия.)

Один из простых подходов к масштабированию во время инференса — это умный промпт-инжиниринг. Классический пример — промптинг с цепочкой размышлений (chain-of-thought, CoT), когда фразы вроде «размышляй шаг за шагом» включаются во входной промпт. Это побуждает модель генерировать промежуточные шаги рассуждения, а не сразу переходить к окончательному ответу, что часто (но не всегда) приводит к более точным результатам для более сложных проблем. (Обратите внимание, что нет смысла использовать эту стратегию для более простых вопросов, основанных на знаниях, например, «Какая столица Франции», что снова является хорошим правилом для определения того, нужна ли модель рассуждений для вашего конкретного входного запроса.)

Вышеупомянутый подход CoT можно рассматривать как масштабирование во время инференса, поскольку он делает инференс более дорогим за счет генерации большего количества выходных токенов.

Еще один подход к масштабированию во время инференса — использование стратегий голосования и поиска. Простой пример — мажоритарное голосование, когда мы заставляем LLM генерировать несколько ответов, и выбираем правильный ответ большинством голосов. Аналогично, мы можем использовать лучевой поиск (beam search) и другие алгоритмы поиска для генерации лучших ответов.

Я настоятельно рекомендую статью Scaling LLM Test-Time Compute Optimally can be More Effective than Scaling Model Parameters, которую я описал в моей предыдущей статье Noteworthy AI Research Papers of 2024 (Part Two), для более подробной информации об этих различных стратегиях.

Различные методы, основанные на поиске, опираются на модель на основе вознаграждения за процесс для выбора лучшего ответа. Аннотированный рисунок из статьи LLM Test-Time Compute, https://arxiv.org/abs/2408.03314

В техническом отчете DeepSeek R1 распространенные методы масштабирования во время инференса (такие как подходы, основанные на вознаграждении за процесс и поиске по методу Монте-Карло) отнесены к категории «неудачных попыток». Это позволяет предположить, что DeepSeek не использовал явно эти техники помимо естественной тенденции модели R1 генерировать более длинные ответы, что служит неявной формой масштабирования во время инференса по сравнению с базовой моделью V3.

Однако явное масштабирование во время инференса часто реализуется на уровне приложения, а не внутри самой LLM, поэтому DeepSeek все еще может применять такие техники в своем приложении.

Я подозреваю, что модели OpenAI o1 и o3 используют масштабирование во время инференса, что объясняет, почему они относительно дороги по сравнению с такими моделями, как GPT-4o. Помимо масштабирования во время инференса, o1 и o3, вероятно, были обучены с использованием конвейеров RL, подобных тем, которые использовались для DeepSeek R1. Подробнее об обучении с подкреплением в следующих двух разделах ниже.

2) Чистое обучение с подкреплением (RL)

Одним из моих личных моментов из статьи DeepSeek R1 является их открытие, что рассуждение возникает как поведение из чистого обучения с подкреплением (RL). Давайте рассмотрим, что это означает более подробно.

Как было описано ранее, DeepSeek разработал три типа моделей R1. Первая, DeepSeek-R1-Zero, была построена на основе базовой модели DeepSeek-V3, стандартной предварительно обученной LLM, которую они выпустили в декабре 2024 года. В отличие от типичных конвейеров RL, где перед RL применяется supervised fine-tuning (SFT), DeepSeek-R1-Zero была обучена исключительно с использованием обучения с подкреплением без начального этапа SFT, как показано на диаграмме ниже.

Тем не менее, этот процесс RL похож на широко используемый подход RLHF, который обычно применяется для настройки предпочтений LLM. (Я более подробно рассмотрел RLHF в моей статье LLM Training: RLHF and Its Alternatives.) Однако, как упоминалось выше, ключевое отличие в DeepSeek-R1-Zero заключается в том, что они пропустили этап supervised fine-tuning (SFT) для настройки инструкций. Именно поэтому они называют это «чистым» RL. (Хотя RL в контексте LLM существенно отличается от традиционного RL, что является темой для другого раза.)

Для вознаграждений, вместо использования модели вознаграждений, обученной на человеческих предпочтениях, они применили два типа вознаграждений: вознаграждение за точность и вознаграждение за формат.

Вознаграждение за точность использует компилятор LeetCode для проверки ответов по программированию и детерминированную систему для оценки математических ответов.

Вознаграждение за формат опирается на судью LLM, чтобы обеспечить следование ответов ожидаемому формату, такому как размещение шагов рассуждения внутри тегов .

Удивительно, что этого подхода было достаточно для того, чтобы LLM развила базовые навыки рассуждения. Исследователи наблюдали момент «Ага!», когда модель начала генерировать следы рассуждений как часть своих ответов, хотя она не была явно обучена этому, как показано на рисунке ниже.

Хотя R1-Zero не является моделью рассуждений с наилучшими показателями, она демонстрирует возможности рассуждения, генерируя промежуточные шаги «мышления», как показано на рисунке выше. Это подтверждает, что можно разработать модель рассуждений, используя чистый RL, и команда DeepSeek была первой, кто продемонстрировал (или, по крайней мере, опубликовал) этот подход.

Ahead of AI — это поддерживаемая читателями публикация. Чтобы получать новые посты и поддержать мою работу, рассмотрите возможность стать бесплатным или платным подписчиком.

Подписаться

3) Supervised finetuning и обучение с подкреплением (SFT + RL)

Далее давайте рассмотрим разработку DeepSeek-R1, флагманской модели рассуждений DeepSeek, которая служит образцом для создания моделей рассуждений. Эта модель улучшает DeepSeek-R1-Zero, включая дополнительную тонкую настройку под наблюдением (SFT) и обучение с подкреплением (RL) для улучшения ее производительности в задачах рассуждения.

Обратите внимание, что включение этапа SFT перед RL является обычной практикой, как это видно в стандартном конвейере RLHF. OpenAI’s o1, вероятно, был разработан с использованием аналогичного подхода.

Как показано на диаграмме выше, команда DeepSeek использовала DeepSeek-R1-Zero для генерации того, что они называют данными SFT с «холодного старта». Термин «холодный старт» относится к тому факту, что эти данные были созданы с помощью DeepSeek-R1-Zero, который сам не был обучен на каких-либо данных supervised fine-tuning (SFT).

Используя эти данные SFT с холодного старта, DeepSeek затем обучил модель с помощью тонкой настройки инструкций, за которой следовал еще один этап обучения с подкреплением (RL). Этот этап RL сохранил те же вознаграждения за точность и формат, которые использовались в процессе RL DeepSeek-R1-Zero. Однако они добавили вознаграждение за согласованность, чтобы предотвратить смешивание языков, которое происходит, когда модель переключается между несколькими языками в рамках одного ответа.

За этапом RL последовал еще один раунд сбора данных SFT. На этом этапе самая последняя контрольная точка модели использовалась для генерации 600 тысяч примеров SFT с Chain-of-Thought (CoT), в то время как дополнительные 200 тысяч примеров SFT на основе знаний были созданы с использованием базовой модели DeepSeek-V3.

Эти 600 тысяч + 200 тысяч образцов SFT затем использовались для тонкой настройки базовой модели DeepSeek-V3 перед переходом к финальному раунду RL. На этом этапе они снова использовали методы на основе правил для вознаграждений за точность для математических и задач программирования, в то время как метки предпочтений человека использовались для других типов вопросов. В целом, это очень похоже на обычный RLHF, за исключением того, что данные SFT содержат (больше) примеров CoT. И RL имеет проверяемые вознаграждения в дополнение к вознаграждениям на основе человеческих предпочтений.

Финальная модель DeepSeek-R1 имеет заметное повышение производительности по сравнению с DeepSeek-R1-Zero благодаря дополнительным этапам SFT и RL, как показано в таблице ниже.

Сравнение бенчмарков моделей OpenAI A1 и DeepSeek R1. Аннотированный рисунок из технического отчета DeepSeek-R1 (https://arxiv.org/abs/2501.12948).

4) Чистое supervised finetuning (SFT) и дистилляция

До сих пор мы рассмотрели три ключевых подхода к созданию и улучшению моделей рассуждений:

1. Масштабирование во время инференса, техника, которая улучшает возможности рассуждения без обучения или иной модификации базовой модели.

2. Чистое обучение с подкреплением (RL), как в DeepSeek-R1-Zero, которое показало, что рассуждение может возникать как изученное поведение без supervised fine-tuning.

3. Supervised fine-tuning (SFT) плюс RL, что привело к DeepSeek-R1, флагманской модели рассуждений DeepSeek.

Итак, что осталось? «Дистилляция» модели.

Удивительно, но DeepSeek также выпустил меньшие модели, обученные с помощью процесса, который они называют дистилляцией. Однако в контексте LLM дистилляция не обязательно следует классическому подходу knowledge distillation, используемому в глубоком обучении. Традиционно, в knowledge distillation (как кратко описано в главе 6 моей книги Machine Learning Q and AI), меньшая модель-ученик обучается как на логитах большей модели-учителя, так и на целевом наборе данных.

Вместо этого здесь дистилляция относится к instruction fine-tuning меньших LLM, таких как Llama 8B и 70B и модели Qwen 2.5 (0.5B–32B), на наборе данных SFT, сгенерированном более крупными LLM. В частности, эти более крупные LLM — это DeepSeek-V3 и промежуточная контрольная точка DeepSeek-R1. Фактически, данные SFT, используемые для этого процесса дистилляции — это тот же набор данных, который использовался для обучения DeepSeek-R1, как описано в предыдущем разделе.

Чтобы прояснить этот процесс, я выделил часть дистилляции на диаграмме ниже.

Процесс разработки моделей DeepSeek-R1-Distill.

Почему они разработали эти дистиллированные модели? На мой взгляд, есть две ключевые причины:

1. Меньшие модели более эффективны. Это означает, что они дешевле в использовании, но они также могут работать на оборудовании более низкого класса, что делает их особенно интересными для многих исследователей и энтузиастов, таких как я.

2. Пример использования чистого SFT. Эти дистиллированные модели служат интересным ориентиром, показывающим, насколько далеко может продвинуть модель чистая тонкая настройка под наблюдением (SFT) без обучения с подкреплением.

В таблице ниже сравнивается производительность этих дистиллированных моделей с другими популярными моделями, а также с DeepSeek-R1-Zero и DeepSeek-R1.

Сравнение бенчмарков дистиллированных и недистиллированных моделей. Аннотированный рисунок из технического отчета DeepSeek-R1 (https://arxiv.org/abs/2501.12948).

Как мы видим, дистиллированные модели заметно слабее, чем DeepSeek-R1, но они удивительно сильны по сравнению с DeepSeek-R1-Zero, несмотря на то, что они на порядки меньше. Также интересно отметить, насколько хорошо эти модели работают по сравнению с o1 mini (я подозреваю, что o1-mini сам может быть аналогично дистиллированной версией o1).

Прежде чем завершить этот раздел выводом, стоит упомянуть еще одно интересное сравнение. Команда DeepSeek проверила, может ли появиться эмерджентное поведение рассуждения, наблюдаемое в DeepSeek-R1-Zero, также и в меньших моделях. Для этого они применили тот же подход чистого RL из DeepSeek-R1-Zero непосредственно к Qwen-32B.

Результаты этого эксперимента обобщены в таблице ниже, где QwQ-32B-Preview служит эталонной моделью рассуждений на основе Qwen 2.5 32B, разработанной командой Qwen (я думаю, что детали обучения никогда не раскрывались). Это сравнение дает некоторое дополнительное понимание того, может ли чистый RL сам по себе вызвать способности к рассуждению в моделях, значительно меньших, чем DeepSeek-R1-Zero.

Сравнение бенчмарков дистилляции и RL на меньшей 32B модели. Аннотированный рисунок из технического отчета DeepSeek-R1 (https://arxiv.org/abs/2501.12948).

Интересно, что результаты позволяют предположить, что дистилляция гораздо более эффективна, чем чистый RL для меньших моделей. Это согласуется с идеей, что одного RL может быть недостаточно для появления сильных способностей к рассуждению в моделях этого масштаба, тогда как SFT на высококачественных данных о рассуждениях может быть более эффективной стратегией при работе с малыми моделями.

Для полноты было бы полезно увидеть дополнительные сравнения в таблице:

1. Qwen-32B, обученный с SFT + RL, аналогично тому, как был разработан DeepSeek-R1. Это помогло бы определить, насколько можно улучшить модель по сравнению с чистым RL и чистым SFT, когда RL комбинируется с SFT.

2. DeepSeek-V3, обученный с чистым SFT, аналогично тому, как были созданы дистиллированные модели. Это позволило бы провести прямое сравнение, чтобы увидеть, насколько эффективен RL + SFT по сравнению с чистым SFT.

Ahead of AI — это поддерживаемая читателями публикация. Чтобы получать новые посты и поддержать мою работу, рассмотрите возможность стать бесплатным или платным подписчиком.

Подписаться

Заключение

В этом разделе мы рассмотрели четыре различные стратегии для создания и улучшения моделей рассуждений:

1. Масштабирование во время инференса не требует дополнительного обучения, но увеличивает затраты на инференс, делая крупномасштабное развертывание более дорогостоящим по мере роста числа пользователей или объема запросов. Тем не менее, это остается очевидным выбором для улучшения производительности уже сильных моделей. Я твердо подозреваю, что o1 использует масштабирование во время инференса, что помогает объяснить, почему он дороже на основе токенов по сравнению с DeepSeek-R1.

2. Чистый RL интересен для исследовательских целей, поскольку он дает представление о рассуждении как эмерджентном поведении. Однако в практической разработке моделей предпочтительным подходом является RL + SFT, так как это приводит к созданию более сильных моделей рассуждений. Я также подозреваю, что o1 был обучен с использованием RL + SFT. Более точно, я считаю, что o1 начинается с более слабой, меньшей базовой модели, чем DeepSeek-R1, но компенсирует это с помощью RL + SFT и масштабирования во время инференса.

3. Как упоминалось выше, RL + SFT является ключевым подходом для создания высокопроизводительных моделей рассуждений. DeepSeek-R1 — хороший образец, показывающий, как это можно сделать.

4. Дистилляция — это привлекательный подход, особенно для создания меньших, более эффективных моделей. Однако ограничением является то, что дистилляция не продвигает инновации и не создает следующее поколение моделей рассуждений. Например, дистилляция всегда зависит от существующей, более сильной модели для генерации данных supervised fine-tuning (SFT).

Один интересный аспект, который я надеюсь увидеть в следующий раз, — это сочетание RL + SFT (подход 3) с масштабированием во время инференса (подход 1). Вероятно, это то, что делает OpenAI o1, за исключением того, что он, вероятно, основан на более слабой базовой модели, чем DeepSeek-R1, что объясняет, почему DeepSeek-R1 так хорошо работает, оставаясь относительно дешевым во время инференса.

Мысли о DeepSeek R1

В последние недели многие люди спрашивали меня о моих мыслях относительно моделей DeepSeek-R1. Вкратце, я считаю, что это потрясающее достижение. Как исследовательский инженер, я особенно ценю подробный технический отчет, который дает представление об их методологии, из которой я могу учиться.

Одним из самых увлекательных выводов является то, как рассуждение возникло как поведение из чистого RL. И впечатляет то, что DeepSeek сделал свои модели открытыми под разрешительной открытой лицензией MIT, которая имеет даже меньше ограничений, чем модели Llama от Meta.

Как она сравнивается с o1?

DeepSeek-R1 лучше, чем o1? Я бы сказал, что они примерно в одной категории. Однако выделяется то, что DeepSeek-R1 более эффективен во время инференса. Это позволяет предположить, что DeepSeek, вероятно, инвестировал больше в процесс обучения, в то время как OpenAI могла больше полагаться на масштабирование во время инференса для o1.

Тем не менее, трудно напрямую сравнивать o1 и DeepSeek-R1, потому что OpenAI не раскрыла много информации о o1. Например, мы не знаем:

Является ли o1 также смесью экспертов (Mixture of Experts, MoE)?

Насколько велика o1?

Может ли o1 быть просто слегка улучшенной версией GPT-4o с минимальным RL + SFT и только обширным масштабированием во время инференса?

Без знания этих деталей прямое сравнение остается сравнением яблок с апельсинами.

Стоимость обучения DeepSeek-R1

Еще одним пунктом обсуждения была стоимость разработки DeepSeek-R1. Некоторые упоминали стоимость обучения около $6 миллионов, но, вероятно, они спутали DeepSeek-V3 (базовую модель, выпущенную в декабре прошлого года) и DeepSeek-R1.

Оценка в $6 миллионов основана на предполагаемой стоимости $2 за час работы GPU и количестве часов GPU, необходимых для финального обучения DeepSeek-V3, о котором первоначально говорилось еще в декабре 2024 года.

Однако команда DeepSeek никогда не раскрывала точное количество часов GPU или стоимость разработки R1, поэтому любые оценки стоимости остаются чистыми спекуляциями.

В любом случае, DeepSeek-R1 — это важная веха в открытых моделях рассуждений, и её эффективность во время инференса делает её интересной альтернативой o1 от OpenAI.

Разработка моделей рассуждений с ограниченным бюджетом

Разработка модели рассуждений уровня DeepSeek-R1 вероятно требует сотен тысяч или миллионов долларов, даже если начинать с открытой базовой модели, такой как DeepSeek-V3. Это может отпугнуть исследователей или инженеров, работающих с ограниченным бюджетом.

Хорошая новость: дистилляция может существенно помочь

К счастью, дистилляция модели предлагает более экономичную альтернативу. Команда DeepSeek продемонстрировала это своими дистиллированными моделями R1, которые достигают удивительно высокой производительности в рассуждениях, несмотря на то, что они значительно меньше, чем DeepSeek-R1. Однако даже этот подход не совсем дешев. Их процесс дистилляции использовал 800 тысяч образцов SFT, что требует значительных вычислительных ресурсов.

Интересно, что всего за несколько дней до выпуска DeepSeek-R1 я наткнулся на статью о Sky-T1, увлекательном проекте, где небольшая команда обучила открытую 32B модель, используя только 17 тысяч образцов SFT. Общая стоимость? Всего $450, что меньше регистрационного взноса на большинстве конференций по ИИ.

Этот пример подчеркивает, что хотя крупномасштабное обучение остается дорогостоящим, меньшие, целенаправленные усилия по тонкой настройке все еще могут дать впечатляющие результаты по цене, в разы меньшей.

Рисунок из статьи «Sky-T1: Train your own O1 preview model within $450», https://novasky-ai.github.io/posts/sky-t1/

Согласно их бенчмаркам, Sky-T1 работает примерно наравне с o1, что впечатляет учитывая низкую стоимость обучения.

Чистый RL с ограниченным бюджетом: TinyZero

В то время как Sky-T1 сфокусирована на дистилляции модели, я также наткнулся на интересную работу в области «чистого RL». Одним из примечательных примеров является TinyZero, модель с 3 миллиардами параметров, которая воспроизводит подход DeepSeek-R1-Zero (примечание: её обучение стоит менее $30).

Удивительно, но даже с всего 3 млрд параметров, TinyZero демонстрирует некоторые эмерджентные способности к самопроверке, что подтверждает идею о том, что рассуждение может возникнуть через чистый RL, даже в малых моделях.

В репозитории TinyZero упоминается, что исследовательский отчет все еще находится в разработке, и я определенно буду следить за дальнейшими деталями.

Рисунок из репозитория TinyZero (https://github.com/Jiayi-Pan/TinyZero), показывающий, что модель способна к самопроверке. (Было бы интересно увидеть ответ базовой модели для сравнения.)

Два вышеупомянутых проекта демонстрируют, что интересная работа над моделями рассуждений возможна даже с ограниченным бюджетом. В то время как оба подхода воспроизводят методы из DeepSeek-R1, один сосредоточен на чистом RL (TinyZero), а другой на чистом SFT (Sky-T1), было бы увлекательно исследовать, как эти идеи могут быть расширены дальше.

За пределами традиционного SFT: Journey Learning

Один особенно интересный подход, с которым я столкнулся в прошлом году, описан в статье O1 Replication Journey: A Strategic Progress Report – Part 1. Несмотря на название, статья на самом деле не воспроизводит o1. Вместо этого она представляет другой способ улучшения процесса дистилляции (чистого SFT).

Ключевая идея в статье — это «journey learning» (обучение через путь) как альтернатива «shortcut learning» (обучению через ярлык).

Shortcut learning относится к традиционному подходу в тонкой настройке инструкций, где модели обучаются, используя только правильные пути решения.

Journey learning, с другой стороны, также включает неправильные пути решения, позволяя модели учиться на ошибках.

Этот подход в некотором роде связан со способностями к самопроверке, наблюдаемыми при чистом RL обучении TinyZero, но он фокусируется на улучшении модели полностью через SFT. Подвергая модель неправильным путям рассуждения и их исправлениям, journey learning также может усиливать способности к самокоррекции, потенциально делая модели рассуждений более надежными таким образом.

Это могло бы стать увлекательным направлением для будущей работы, особенно для разработки моделей рассуждений с низким бюджетом, где подходы на основе RL могут быть вычислительно непрактичными.

В любом случае, в настоящее время происходит много интересной работы в области моделей рассуждений, и я уверен, что в ближайшие месяцы мы увидим еще много захватывающих исследований!

Источник: https://habr.com/ru/articles/894688/